Wenn ihr eure Webseite wie verrückt optimiert, aber euer Suchmaschinenranking einfach nicht besser wird, liegt das häufig an sogenanntem Duplicate Content. Wenn Google auf eurer Seite doppelt sieht, straft euch die Suchmaschine mit schlechten Rankings ab. Dabei gibt es ganz unterschiedliche Arten von Duplicate Content und manche davon lassen sich erst bei genauem Hinsehen entdecken. Ich verrate euch heute, welche das sind und wie ihr sie auf eurer Webseite findet.

Also rein ins Backend. Es wird Zeit für einen Frühjahrsputz…

Duplicate Content verschlechtert euer Googleranking

Duplicate Content heißt auf Deutsch „doppelter Inhalt“ und bezeichnet Webseitencontent, der von Suchmaschinen beim Crawling als Dublette eines anderen Inhalts erkannt wird. Wenn das passiert, senkt die Suchmaschine die Sichtbarkeit der betroffenen Seite. Vermutet die Suchmaschine Content- Diebstahl, wird die betroffene Seite unter Umständen sogar gar nicht mehr indexiert. Da Duplicate Content in allen Disziplinen des Onlinemarketings auftreten kann, sind Onlineredakteure, Content Manager und SEOs gleichermaßen gefragt, diesen zu finden und zu beseitigen. Dabei sind ganz unterschiedliche Elemente von dem Problem betroffen:

Risiko 1: Textbausteine

Verwendet ihr auf eurer Website Textbausteine? Selbst wenn ihr zu fünf verschiedenen Dienstleistungen immer das gleiche Zusatzangebot bietet, ist Copy and Paste eine schlechte Idee. Versucht auf Textbausteine vollständig zu verzichten. Wenn euer Zusatzangebot für den Kunden so relevant ist, dass ihr es auf jeder Seite unterbringen wollt, widmet ihm doch eine eigene Seite und verlinkt diese auf den betroffenen Seiten. Beim Link geht ihr darauf ein, warum das Zusatzangebot gerade für dieses Produkt wichtig ist. So bleibt ihr im Kontext eures Angebots und schafft eine Seite, die auch unabhängig davon gefunden werden kann.

Risiko 2: Pressemitteilungen

Wenn Onlinemagazine und Plattformen eure Pressemitteilungen verwenden, ist das eine gute Werbestrategie, um die Aufmerksamkeit eurer Zielgruppen auf neue Produkte zu lenken. Da Pressemitteilungen aber im Normalfall 1:1 so auf fremden Websites zu finden sind, wie sie auch bei euch erscheinen, werden diese häufig als Duplicate Content erkannt. Google bietet keine Möglichkeit, die Urheberschaft an einem Stück Content zu übermitteln und geht deswegen davon aus, dass derjenige, bei dem der Inhalt zuerst gecrawlt wurde, auch dessen Urheber ist. Achtet also darauf eure eigenen Mitteilungen unbedingt zuerst online zu stellen und bei der Google Search Console zum Crawling einzureichen.

Risiko 3: Artikelbeschreibungen

Wenn ihr einen Onlineshop betreibt, sind vor allem eure Produktbeschreibungen anfällig für Duplicate Content. Wenn ihr zum Beispiel Produktbeschreibungen eurer Lieferanten übernehmt, ist das nämlich nicht nur eine Frage von Urheberrechten, (gerade für die Onlinewerbung werden gerne Nutzungsrechte gewährt), sondern auch ein Thema von Duplicate Content. Wenn ihr also nicht vertraglich an die Werbetexte des Herstellers gebunden sein, schreibt eure eigenen Artikeltexte. So könnt ihr außerdem den Kontext zum eigenen Shop leichter herstellen und seid nicht nur der x-te Händler mit identischem Warenportfolio.

Manche Onlineshops schaffen es aber auch, aus den eigenen Texten Duplicate Content zu erstellen. Denn gerade wenn vom selben Produkt mehrere Versionen angeboten werden, zum Beispiel Farben oder Größen, finden sich in machen Shops mehrere Artikelseiten. Legt in solchen Fällen auf jeden Fall Varianten an. So kann der Kunde, meist über ein Dropdown, die richtige Farbe, Größe oder Abfüllung wählen. Ein weiterer Vorteil: Ihr sammelt alle Klicks und Conversions zum Produkt auf einer einzigen Seite, so wird diese für Google relevanter und steigt im Ranking. Ganz nebenbei ist euer Shop im Front- und Backend schlanker und übersichtlicher.

Risiko 4: Technisch produzierter Duplicate Content

Im Gegensatz zu den vorher genannten Risiken, die vorrangig auf redaktioneller Seite zu beachten sind, gibt es auch technisch verursachten Duplicate Content. Normalerweise entsteht dieser, wenn parallele Versionen verschiedener Seiten mit demselben oder nur marginal unterschiedlichem Inhalt von Google nicht richtig erkannt werden oder wenn dieselbe Seite über unterschiedliche URLs aufrufbar ist. Die üblichen Verdächtigen sind:

- http und https URL eurer Seite (http://www.beispiel.de vs. https://www.beispiel.de)

- URL mit und ohne / am Ende (www.beispiel.de vs. www.beispiel.de/)

- URL mit und ohne www (beispiel.de vs. beispiel.de)

- URL mit Groß-/Kleinschreibung (www.beispiel.de vs. www.Bde)

- mobile Versionen von Seiten (beispiel.de vs. m.beispiel.de)

- Druckversionen von Seiten (PDF konkurriert mit URL)

- Textdubletten in den Metadaten

Diese Probleme aus dem Weg zu schaffen, ist eine der Hauptaufgaben eines SEO. Viele der Lösungen sind am Server vorzunehmen oder benötigen Arbeit am Code eurer Seite und sind deswegen ein wenig kniffelig. Zudem können eure Lösungen je nach den technischen Voraussetzungen ganz unterschiedlich aussehen. Wenn ihr mit solchen Dingen nicht vertraut seid, wendet euch am besten an eine SEO Agentur. Die nützlichsten Tools, mit denen ihr technisch verursachten Duplicate Content auf eurer Seite findet, möchte ich euch trotzdem nicht vorenthalten. Denn auch wenn ihr diese Dopplungen vielleicht nicht selbst behebt, seid ihr ja dennoch für die Erfolgskontrolle eures Dienstleisters zuständig:

Seitenstatus prüfen mit httpstatus.io

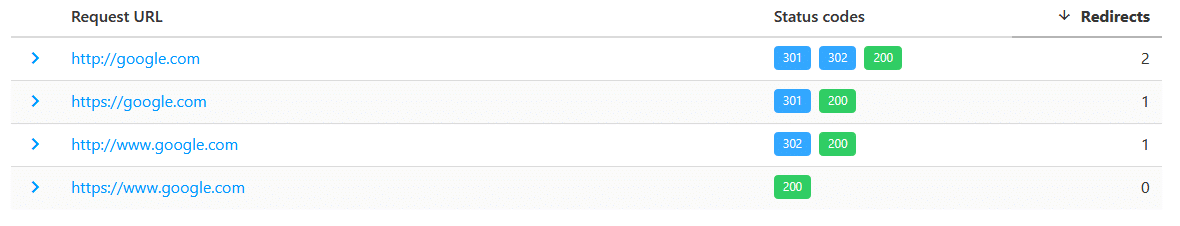

Ob verschiedene URLs auf dieselbe Seite führen, lässt sich auf der Website httpstatus.io überprüfen. Gebt dort die betroffenen URLs ein und fragt den Status der Seiten ab. Wenn beide Seiten den Statuscode 200 (okay) zurückgeben, habt ihr ein Problem, weil sie dann in Googles Augen konkurrieren. Das erkennt ihr auch daran, dass die Tools von Google die geprüften URLs getrennt aufführen. Wer in Analytics schon einmal eine Seite gesehen hat, die schlicht „/“ lautet, weiß jetzt, dass diese Seite ein Duplicate Content Problem hat.

Das Problem lässt sich lösen, indem ihr 301 Weiterleitungen (permanent verschoben) für die Nebenversionen einrichtet. Dann müsst ihr nur noch entscheiden, wie euch eure Seite besser gefällt, mit oder ohne www, Slash oder Kleinschreibung. Wenn eure Umleitung für Google sichtbar eingerichtet wurde, gibt httpstatus.io zusätzlich zum Code 200 auch den Code 301 aus.

Mehr Informationen zu den Statuscodes eurer Website findet ihr außerdem im Artikel Von 403 bis 504: Diese Website-Fehlercodes gibt es und das könnt ihr dagegen tun.

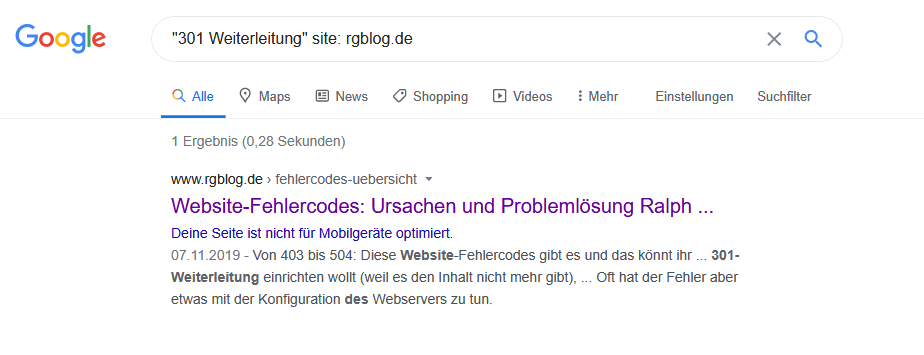

Seitencontent und PDF identisch

Im Rahmen eurer Content Strategie bietet ihr auch PDFs zum Download an? Das ist für eure Kundenbindung auf jeden Fall eine gute Idee. Damit das allerdings keine negativen Auswirkungen auf euer Google Ranking hat, solltet ihr das PDF von der Indexierung ausschließen. Denn ebenso wie der HTML Text eurer Website, wird der Content im PDF standardmäßig von der Suchmaschine durchsucht. Um zu prüfen, ob PDF und Website bei euch auf der Seite konkurrieren, gebt eine Textpassage aus dem PDF bei Google ein und setzt diese in Anführungszeichen. Das beschränkt die Ergebnisse auf den genauen Wortlaut. Setzt dahinter noch ein „site:“ und eure Domain, das schränkt die Suche auf eure Website ein. („So zum Beispiel“ site: beispiel.de). Wenn euch der Trick gefallen hat, ist vielleicht der Blogbeitrag Google Hacks: Nützliche Google-Funktionen für Business und Alltag etwas für euch.

Findet ihr sowohl eure Website als auch das PDF, geht die Suchmaschine in diesem Fall von Duplicate Content aus. Stellt die Robots-Meta-Tags auf der PDF-Seite deswegen auf „noindex, follow“. So taucht das PDF nicht in der Suche auf, die Links werden aber dennoch analysiert.

Bietet ihr den Inhalt eurer Seite als Druckversion an? Bei Rezepten oder Statistiken kann das durchaus empfehlenswert sein, erstellt dafür aber bitte keine extra Seite. Sonst droht euch dasselbe Problem wie mit den PDF. Legt stattdessen eine print.css im Head der betroffenen Seite an. Zugegeben, das ist für Ungeübte nicht ganz leicht, dafür könnt ihr individuelle Seitenumbrüche erzeugen und überflüssige Inhalte wie große Bilder oder Werbebanner für den Druck ausblenden.

Mobile Versionen auszeichnen

Die Optimierung von Seiten für mobile Zugriffe ist eines von Googles Lieblingsthemen. Bei der Indexierung setzt Google mittlerweile vollständig auf Mobile First. Das heißt, Seiten die ideal auf eine mobile Ansicht optimiert sind haben im Ranking die Nase vorn. Viele Webseiten wurden deswegen auf Responsive Design umgestellt. Wenn eure Seite responsive ist, habt ihr auch in Sachen Duplicate Content deswegen keine Probleme. Wenn ihr mit mobilen Versionen eurer Seiten arbeitet, ist das völlig in Ordnung. Stellt allerdings sicher, dass diese mit einem canonical auf das Original verweisen. So legt ihr fest, welche Seite die Hauptvariante ist und bevorzugt gecrawlt werden soll.

Duplicate Content in den Metadaten

Seid ihr euch sicher, dass ihr euch in euren Title Tags und Meta-Descriptions nicht wiederholt? Mit dem Tool „Screaming Frog“ könnt euch die Metadaten eurer Seiten als Excel Tabelle ansehen und habt so alle wichtigen Infos auf einen Blick. Allerdings muss das Programm dafür heruntergeladen werden. In der Basisversion, mit der ihr bis zu 500 Seiten prüfen könnt, ist das Tool kostenlos. So wird die Suche nach Dubletten deutlich einfacher.

Fazit: Es gibt unzählige Möglichkeiten, Duplicate Content zu produzieren und deswegen so einiges zu beachten. Auch wenn ihr alle Tricks kennt, in der Realität ist kaum ein Internetauftritt völlig frei von doppelten Inhalten. Wenn ihr eure Website jetzt auf Vordermann bringen wollt, wünsche ich auf jeden Fall viel Erfolg und einen ordentlichen Rankingboost! 😉

Weitere interessante Artikel: